Vivemos imersos num universo digital repleto de postagens e curtidas nas redes sociais, imagens e vídeos de telefones celulares enviados para o YouTube, filmes digitais de alta definição, movimentações bancárias, imagens de câmaras de segurança, colisões subatômicas registradas pelo LHC do CERN, chamadas telefônicas, mensagens SMS, etc. (GANTZ; REINSEL, 2012).

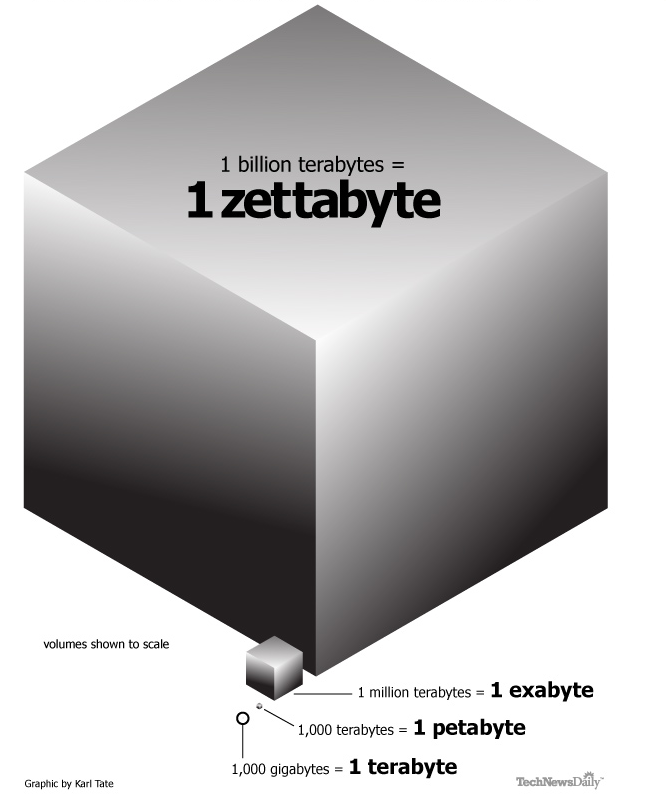

Em 2010, esse universo digital atravessou a marca de 1 zettabyte (um milhão de petabytes ou aproximadamente 1021) de dados (ZIKOPOULOS et al., 2013, p. 9), devendo dobrar a cada dois anos (GANTZ; REINSEL, 2012)!

Vivemos na onda do Big Data!

Um caso elucidativo, embora talvez apenas lendário, é o da rede de lojas Target.

O sistema de cartões de clientes registra todas as compras de cada cliente.

Sabendo que o nascimento de uma criança gera uma grande quantidade de compras, envolvendo berços, fraldas, roupas de bebê, etc., a empresa fez uma campanha para que as clientes informassem quando estavam grávidas e para quando estimavam o nascimento de seus bebês.

Em seguida, uma mineração dessa quantidade de dados revelou um padrão. Poucos meses antes de dar à luz, todas as clientes compravam certos produtos específicos: cremes e colônias com fragrâncias mais suaves e suplementos ricos em magnésio, cálcio e zinco.

Passaram, então, a monitorar as compras das clientes e, quando esse padrão de compras ocorria, previam que se tratava de uma futura mamãe e antecipavam-se, enviando-lhes cupons de desconto para fraldas, berços, e outros ítens adequados, procurando fidelizar essas futuras compras.

Diz a lenda que um pai de uma adolescente que recebeu esses cupons pelo correio ligou furioso para a Target acusando-a de estar estimulando sua filha a engravidar, apenas para descobrir depois que, aparentemente, o Big Data sabia mais sobre sua filha do que ele mesmo!

Outro exemplo interessante é o bem conhecido motor de buscas Google. Todas as pesquisas que fazemos são armazenadas em gigantescos data center espalhados ao redor do mundo. Com esse mar de dados, o Google não só consegue fornecer os melhores resultados de pesquisa no topo da página, como afinar os anúnicos para os interesses do visitante.

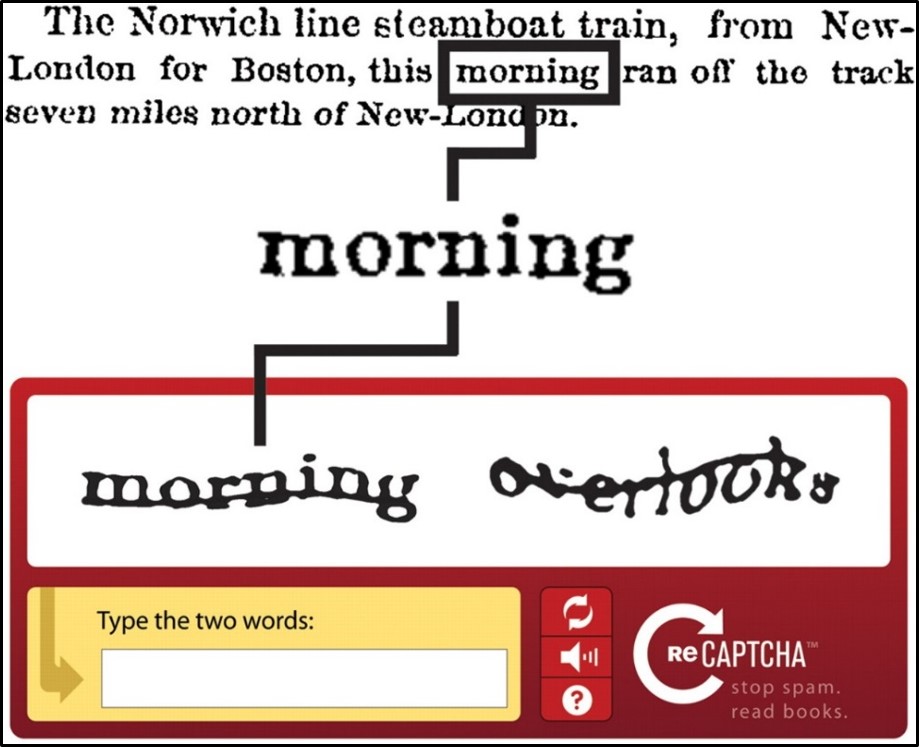

O Google também gerencia o sistema recaptcha para auxiliar seu projeto de digitalização de livros. Cada palavra cuja digitalização não foi satisfatória é enviada para o sistema recaptcha, juntamente com outra palavra conhecida. Através da inteligência coletiva de seus bilhões de usuários, essas digitalizações são corrigidas gratuitamente.

O título do livro de Mayer-Schönberger e Cukier (2013), Big Data: Uma Revolução que vai transformar a maneira como vivemos, trabalhamos e pensamos, dá uma boa ideia do tamanho da proposta do Big Data e, também, da hype (oba-oba) que o acompanha.

Entusiastas do Big Data já falam no “fim da teoria”, que “o Método Científico está obsoleto” (ANDERSON, 2008),...

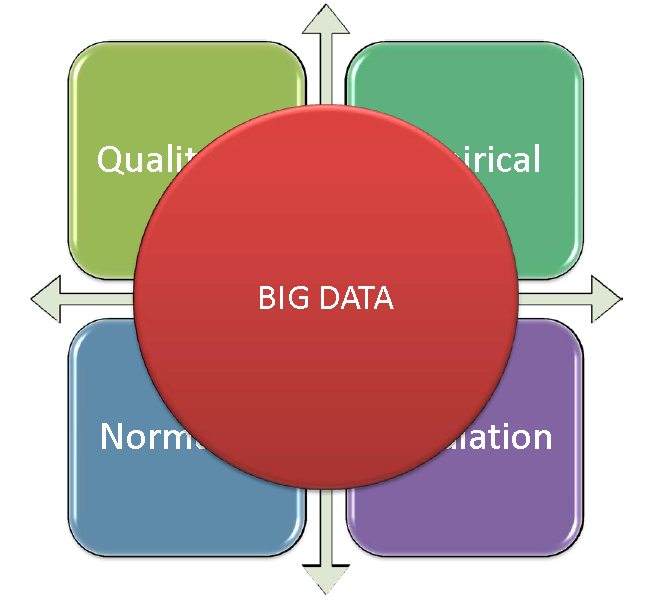

e que Big Data seria um novo paradigma de pesquisa, superando o Qualitativo, o Empírico, o Normativo e a Simulação (Figura 1).

Dentre as muitas definições de Big Data encontradas, preferimos a seguinte, por a julgarmos mais esclarecedora para os propósitos deste trabalho:

Big data é mais do que simplesmente uma questão de tamanho, é uma oportunidade de encontrar insights em novos e emergentes tipos de dados e conteúdos, para tornar seu negócio mais ágil e para responder a perguntas que foram anteriormente consideradas fora de seu alcance (IBM s.d.).

Na verdade, esta ideia de talvez poder "responder a perguntas que foram anteriormente consideradas fora de alcance" nos motivou a iniciar um projeto de pesquisa sobre a utilização de Big data no ensino de ciências com ferramentas públicas gratuitas.

Inteligência ArtificialA inteligência artificial não é algo novo. Remonta aos anos 60.

Porém, era bastante restrita a especialistas que precisavam utilizar linguagens de programação especiais para resolver seus problemas, tais como Lisp, Prolog, etc.

Quando me interessei por IA na década de 1970, era tentador programar jogos como jogo da velha e xadrez.

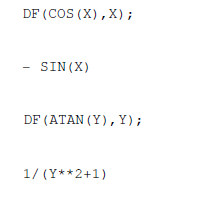

Quando me envolvi com IA na década de 1980, tratava-se de sistemas que fazem cálculos algébricos, como Reduce

e depois Maple, incluindo integrais indefinidas.

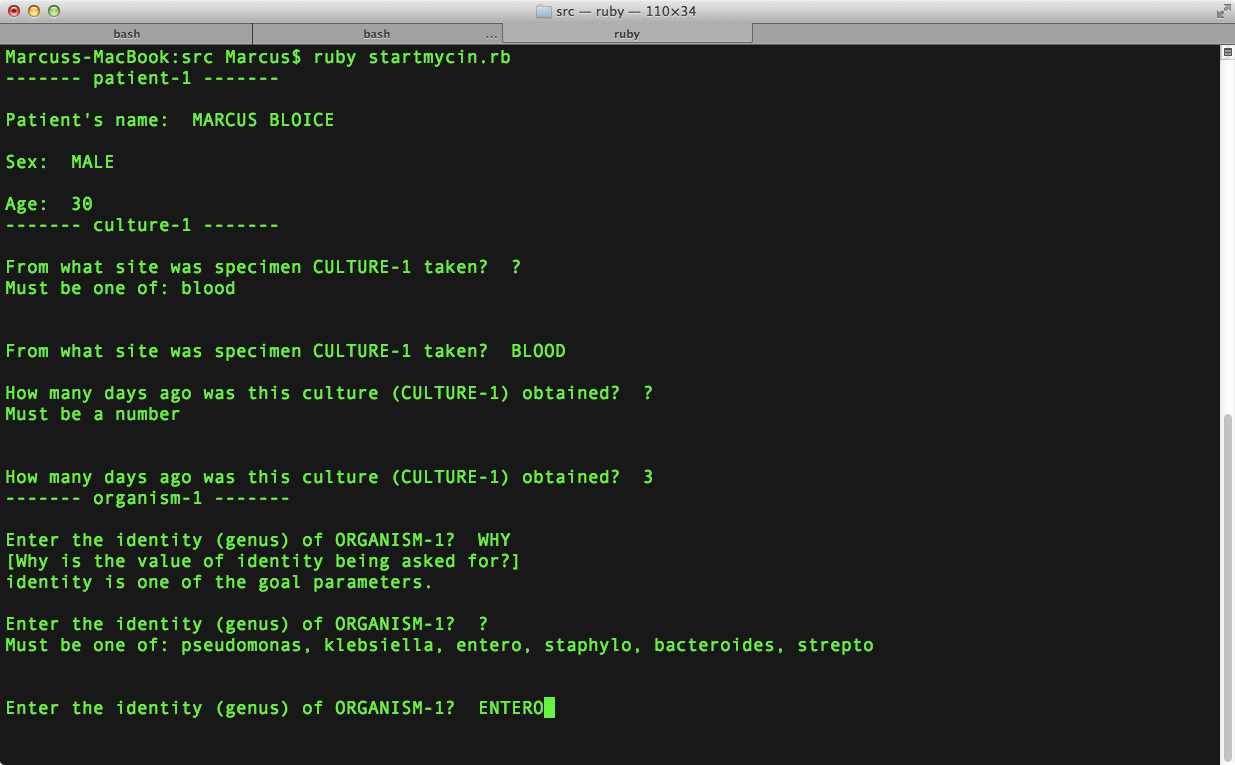

Na década de 1990, tratava-se de construir sistemas especialistas que, como o nome diz, imitavam especialistas (médicos, advogados, físicos etc.), programando seus conhecimentos específicos à mão. Um exemplo famoso foi o Mycin, desenvolvido para identificar as bactérias causadoras de infecções graves e recomendar os antibióticos adequados.

Mas havia um problema na programação clássica de xadrez. Estima-se que haja 10120 combinações de lances!

E perguntar aos especialistas, os grandes mestres de xadrez, também não resolvia porque eles não sabem explicar como raciocinam.

Então, se desenvolveu a técnica de aprender fazendo: Definem-se variáveis relevantes, tais como vantagem de peças, ocupação do tabuleiro, etc. e constrói-se um modelo. E, depois, faz-se um treinamento, pondo o programa a jogar com humanos e fazendo com que ele ajuste os pesos atribuídos às variáveis, refinando o modelo.

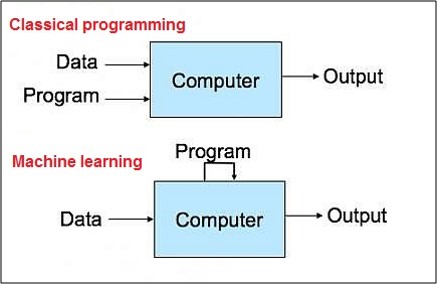

Isso é o que se chama de aprendizagem de máquina (machine learning).

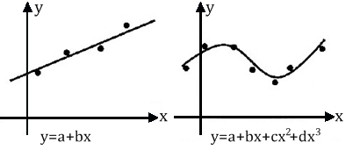

Isso é semelhante ao método dos mínimos quadrados. Quanto mais variáveis, mais parâmetros.

Modelos mais sofisticados também possuem termos não lineares e ainda mais parâmetros.

Para comparação, o modelo do chatGPT tem 175 bilhões de parâmetros!

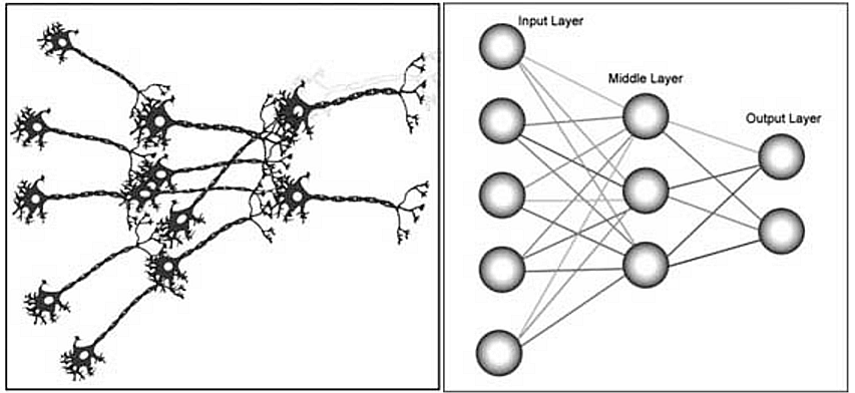

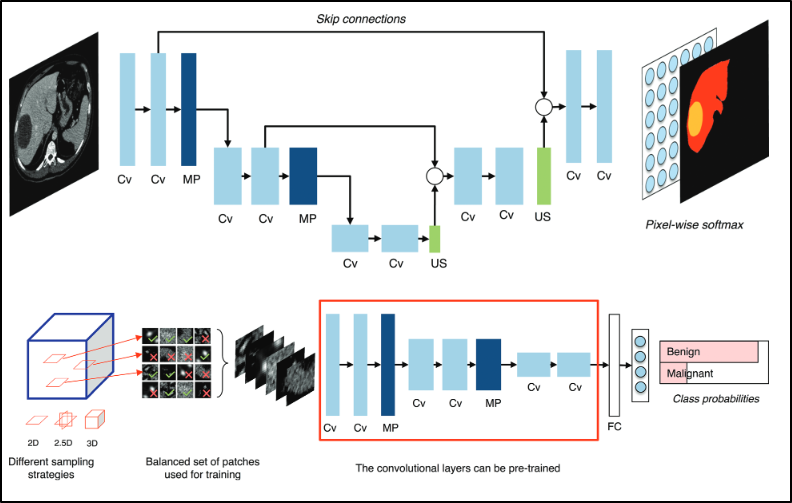

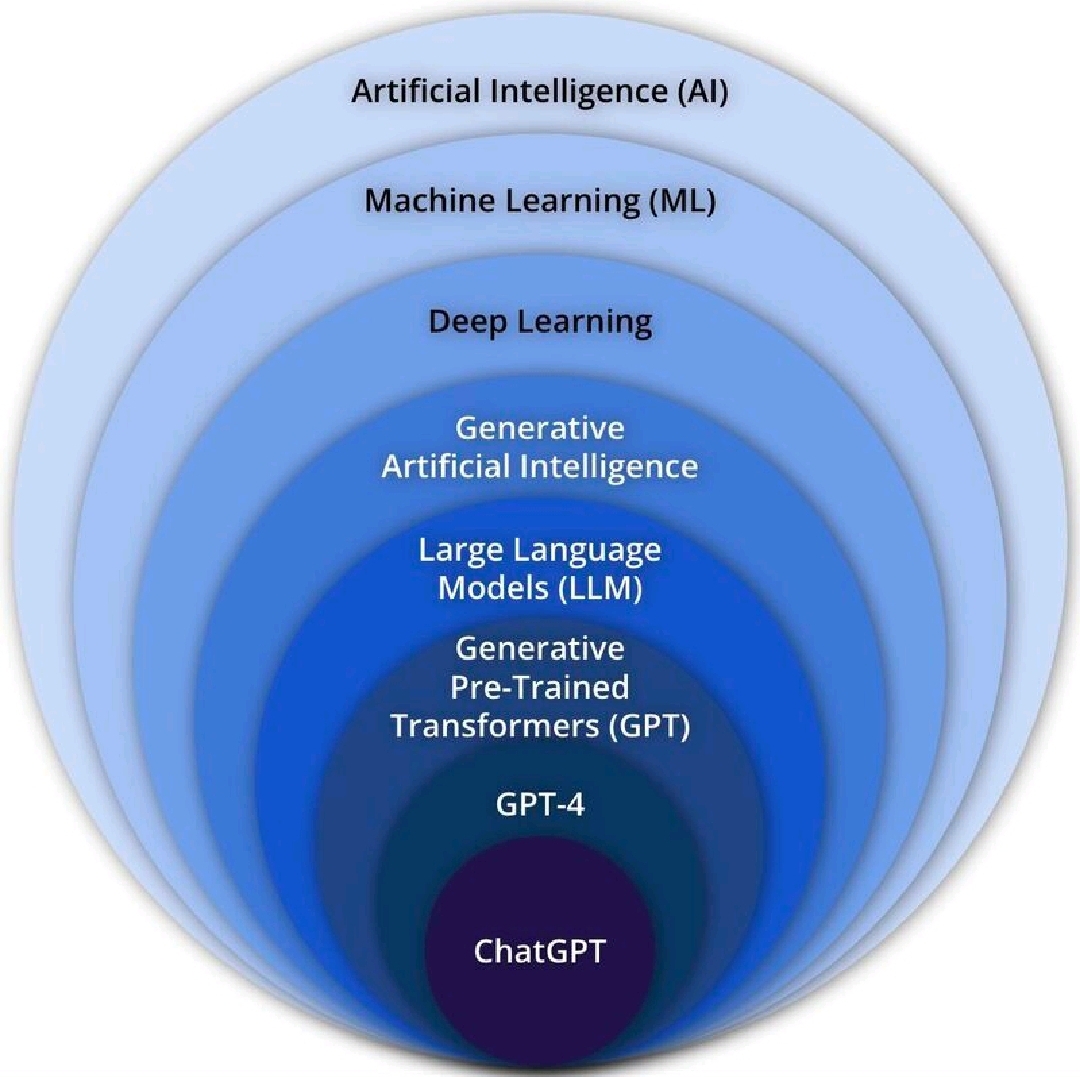

Deep LearningPara compreender o estágio atual da Inteligência Artificial (IA) e, especialmente, a Deep Learning (DL), vale lembrar que nosso cérebro funciona baseado numa rede de neurônios interligados por sinapses (rede neural), capaz de evoluir. A DL tenta, de certa forma, mimetizar esse processo, por uma rede de nós de processamento, distribuídos em camadas, cada um executando uma machine learning!

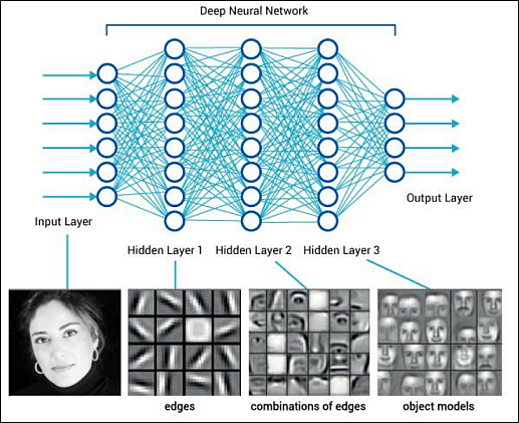

Os nós de uma camada recebem os modelos da camada anterior e os recombinam, gerando modelos cada vez mais sofisticados. Por isso que se diz jocosamente que, no fundo, DL é multiplicação de matrizes!

A grande diferença da programação convencional, e mesmo dos primórdios da IA, é que a própria DL constrói seu modelo que interpreta os dados, sem intervenção dos programadores. Isto é, a DL busca, ela mesma, algum padrão entre os dados.

Assim, por exemplo, se fornecem alguns milhões de fotos de rostos humanos. As variáveis aqui serão os valores R, G, B, Y de cada pixel das fotos.

A DL analizará as fotos e, gradual e automaticamente, identificará padrões, que se podem associar a elementos estruturais nas imagens, tais como fronteiras entre regiões de claro e escuro, evoluindo para bordas e contornos, partes do rosto, até rostos completos.

Nesta altura, a DL será capaz de comparar rostos e fazer reconhecimento facial dentro da base de dados fornecida.

Esse recurso já é usado em análise de radiografias e tomografias, para uma localização e identificação de anomalias com mais precisão do que especialistas humanos.

Embora isso já seja fascinante, é importante ressaltar que esse mesmo processo pode ser realizado com outros tipos de conjuntos de dados.

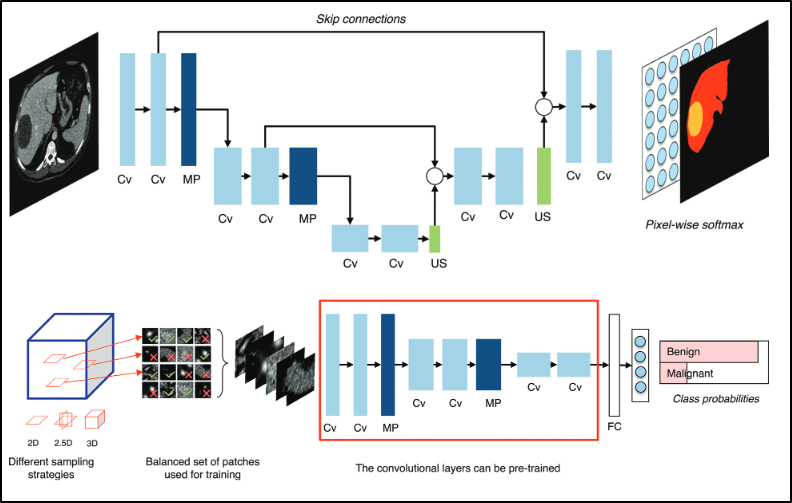

Assim, por exemplo, a DL já vem sendo usada na indústria farmacêutica...

e na demonstração de teoremas de Matemática!

O mais fascinante, do ponto de vista epistemológico, é que nem sempre as 'estruturas' identificadas pela DL correspondem a estruturas construídas pela ciência convencional!

Isso quer dizer que a IA pode estar, finalmente, dando uma resposta para a velha questão sobre se a Matemática existe independente de nós, ou se foi criada por nós, sendo possível existirem outras matemáticas diferentes, confirmando a ideia de Etnomatemática de Ubiratan D'Ambrósio.

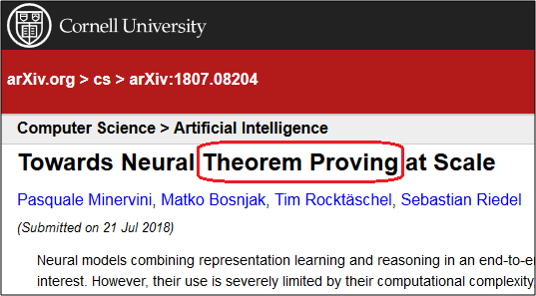

IA GenerativaEm novembro de 2022, fomos supreendidos com uma nova forma de IA, a chamada IA generativa, (IAGen) na forma do já famoso ChatGPT!

Na verdade, o impacto foi tão grande que muita gente está usando o termo IA para se referir ao ChatGPT, o que não é correto, já que ele é apenas uma aplicação da AIGen, que é uma apenas uma pequena subarea da IA. Este diagrama pode facilitar o entendimento dessa relação.

A IAGen se caracteriza por entender instruções em nossa linguagem natural, em vez de precisar de linguagens de programação específicas.

E, também, por gerar resultados originais a partir do seu treinamento, em vez de apenas analisar os dados fornecidos.

Aliás, essa a origem da letra G no nome ChatGPT.

Da mesma forma que no jogo de xadrez, inicialmente o Processamento de Linguagem Natural procurou codificar regras linguísticas, tendo por base as teorias da linguística de Chomsky, dentre outros modelos teóricos.

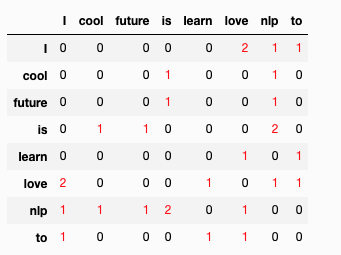

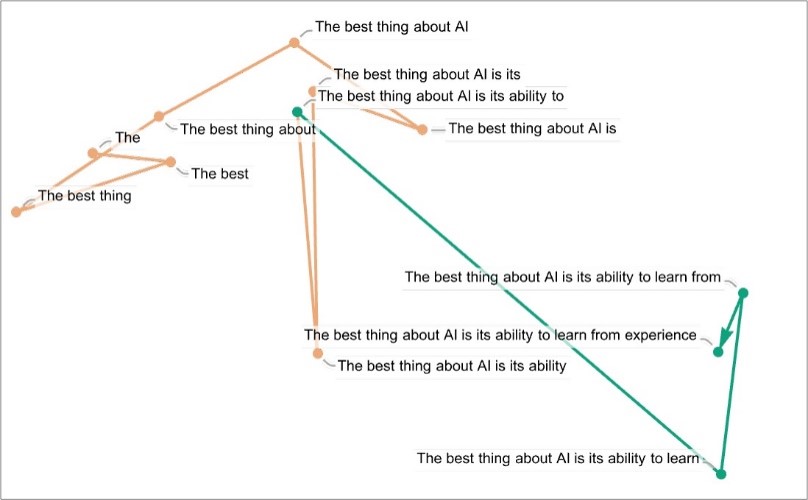

Com o avanço da DL, agora é calculada a frequência com que uma determinada palavra segue outra nos textos disponibilizados no treinamento. A partir daí, são calculadas as probabilidades de ocorrência dessas sequências.

A partir daí, os sistemas generativos de IA, após interpretarem a pergunta, 'simplesmente' geram respostas palavra por palavra, usando essas probabilidades calculadas.

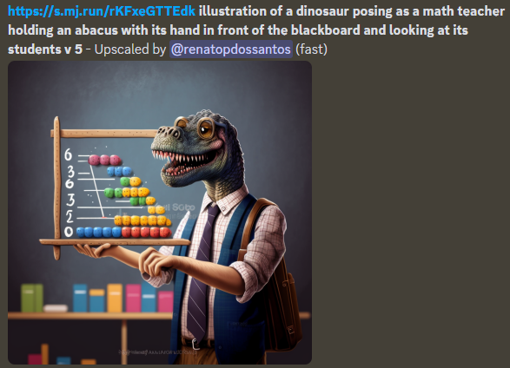

Vale notar que a IAGen não gera só texto, mas, também, imagens, vídeos, música, programas de computador, apresentações de PowerPoint, etc.

E, nessa questão de gerar imagens, surge a questão de se a IAGen pode produzir arte e, naturalmente, volta a discussão sobre o que é arte?

Por exemplo, esta obra, intitulada Théâtre D'opéra Spatial, foi gerada pelo Midjourney com um prompt de Jason Michael Allen.

Ela obteve o primeiro prêmio na seção de "artes digitais/fotografia manipulada digitalmente" do concurso anual de belas artes da Feira Estadual do Colorado de 2022, tornando-se uma das primeiras imagens geradas por IA a ganhar um prêmio.

Estamos ainda no início da exploração do potencial da GenIA e não conseguimos vislumbrar todo seu potencial.

Muitos acreditam mesmo que, devido aos avanços da IA e à recente explosão no uso da IAGen, estamos iniciando uma nova Renascença, com enorme avanço cultural, científico e tecnológico.

Curiosamente, em 2021, no auge da pandemia da Covid-19, Maitê Proença postou em sua rede social se, semelhantemente à Idade Média, após essa praga não viria uma nova Renascença.

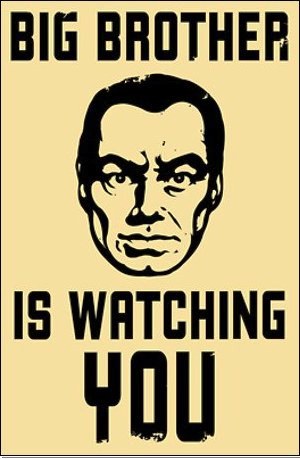

Privacidade?

Entretanto, há uma tendência mundial de se considerar como bem público dados tais como os provenientes de telefones celulares ou do Twitter (WORLD ECONOMIC FORUM, 2012). Nestes dias de recentes denúncias de vigilância e interceptação do tráfego em telefones, emails e redes sociais pela Agência de Segurança Nacional (NSA) dos EUA (GELLMAN; POITRAS, 2013), interpretações como essa inflamam as preocupações com a privacidade no Big Data.

Por outro lado, argumenta-se que já estamos espontaneamente abrindo mão de nossa privacidade ao compartilharmos todo tipo de informação pessoal nas redes sociais.

Por outro lado, até que ponto a imersão na hiperrealidade pode ser mais prazenteira, desejável ou 'real' do que a vivência na realidade cotidiana? Basta pensar no caso de Nick Dupree, um ativista dos direitos dos portadores de deficiência, escritor, wikipedista, investigador, desenhista, autor de histórias em quadrinhos, famoso dj no Second Life (Namav Abramovic) etc., dependente de um ventilador (pulmão artificial), que não pode nem mesmo levantar as mãos.

Até que ponto muitos internautas não preferirão essa Internet 3D imersiva e hiperreal, tal como Cypher, que preferiu voltar à Matrix, porque, para ele, esta era uma realidade melhor do que a realidade 'real'.

Juntando essa hiperrealidade imersiva com o fim da privacidade, nosso futuro será mesmo, afinal, a Matrix?

Voltar à Parte Anterior

Voltar a Minhas Aulas.

Voltar ao começo desta página

Voltar à página principal de Física Interessante